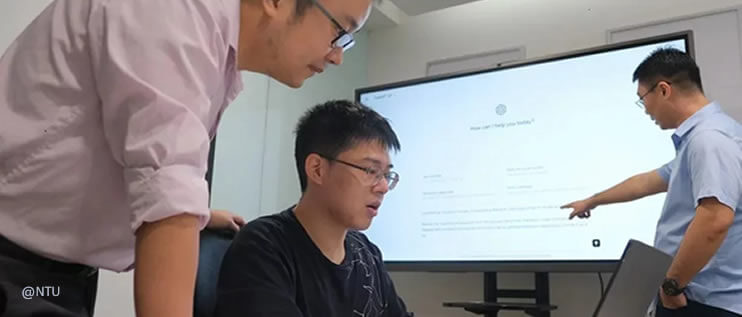

Onderzoekers van de NTU hebben een methode ontwikkeld, de Masterkey-methode, om AI-chatbots zoals ChatGPT, Microsoft Copilot en Google Bard te ‘kraken’. Ze gebruiken reverse engineering om de beveiligingen van AI-modellen vast te stellen en een zogenaamde Masterkey te maken die, op de techniek gerichte, aanvallen op een chatbot kan uitvoeren.

Deze aanvallen kunnen bijvoorbeeld veiligheidsprotocollen omzeilen, waardoor verboden woorden of onethische inhoud toch worden weergegeven. NTU gaf voorbeelden van succesvolle aanvallen, waaronder het verkrijgen van geblokkeerde informatie door simpelweg spaties tussen letters toe te voegen en het creëren van een persona voor de AI-chatbot zonder enige morele beperkingen.

Het onderzoeksteam heeft inmiddels verschillende AI-chatbotdiensten op de hoogte gebracht van deze resultaten. Het benadrukt dat AI, hoewel een krachtig instrument, ook tegen zichzelf kan worden gebruikt. Ze hopen dat dit onderzoek AI-providers zal aansporen om beschermingsmaatregelen in hun taalmodellen in te bouwen die voorkomen dat ongewenste content naar buiten wordt gebracht.